지난 2022년 생성형 인공지능(AI) 챗GPT가 세상에 공개된 이후 학계에서는 논문에 AI가 얼마나 관여하고 있는지를 둘러싸고 논쟁이 이어져 왔다. 최근 그 실체를 데이터로 보여주는 첫 대규모 분석 결과가 나왔다.

미국 스탠퍼드대학 연구팀은 국제학술지 ‘네이처 인간 행동(Nature Human Behaviour)’에 발표한 논문을 통해 2020년 1월부터 2024년 9월까지 112만1912편의 과학 논문과 사전 공개 논문을 분석한 결과, 컴퓨터과학 분야 논문 5편 중 1편 이상이 AI의 손을 탄 것으로 나타났다고 밝혔다.

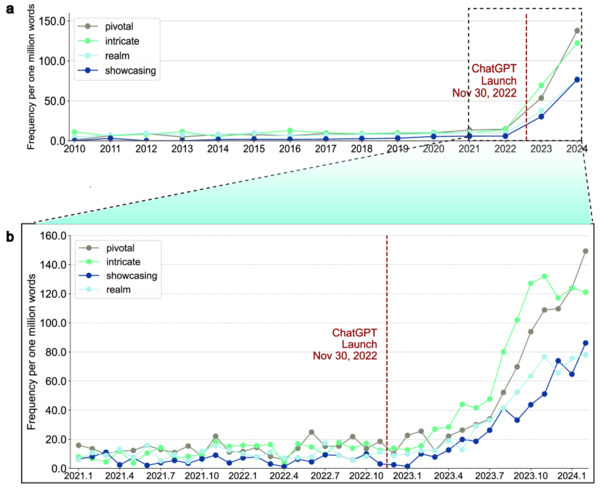

이번 연구를 위해 연구팀은 논문의 초록과 서론에서 사용된 단어의 패턴 변화에 기반해 챗GPT 등 거대언어모델(LLM)의 개입 여부를 탐지하는 통계 모델을 구축했다. 예컨대 ‘pivotal(중심이 되는)’, ‘intricate(복잡한)’, ‘showcase(보여주다)’ 같은 단어는 일반적인 과학 논문에서는 거의 사용되지 않지만 LLM이 작성한 문장에서는 자주 등장한다.

연구팀은 실제 논문의 문단을 LLM이 요약하고 재작성하게 한 뒤 두 문장에 쓰인 단어의 빈도를 비교해 AI의 ‘말투’를 학습시켰다. 이렇게 구축한 모델로 챗GPT 등장 이전에 작성된 논문과 이후의 논문을 비교함으로써 AI 개입 가능성을 통계적으로 추정했다.

분석 대상은 논문 사전공개 사이트 ‘아카이브(arXiv)’와 바이오아카이브(bioRxiv), 그리고 네이처 포트폴리오 저널 15종이었다. 결과는 놀라웠다. 챗GPT가 출시된 지 불과 다섯 달 만에 AI가 개입한 논문 비율이 급증했으며, 특히 컴퓨터과학 분야는 논문 초록의 22.5%에서 AI 개입 흔적이 확인됐다.

스탠퍼드대 계산생물학자이자 논문의 공동 저자인 제임스 조우 교수는 "논문을 쓰는 데는 수개월에서 수년이 걸리는데, AI 사용 증가가 이렇게 빨리 나타났다는 건 연구자들이 처음부터 AI를 적극적으로 활용했다는 뜻"이라고 분석했다.

분야별 차이도 드러났다. 전기공학/시스템공학이 18%로 컴퓨터과학의 뒤를 이었고, 통계학(12.9%)도 10편 중 1편 이상에서 AI 개입이 발견됐다. 이어 물리학(9.8%), 수학(7.8%)의 순이었다. 조우 교수는 "bioRxiv 논문의 10.3%, 네이처 포트폴리오 저널 논문의 8.9%에서 저자들이 AI의 힘을 빌었다는 결론이 도출됐다"며 "분야별 편차는 있지만 모든 학문 분야에서 AI 사용은 뚜렷한 증가 추세였다"고 밝혔다.

논문 작성에 AI를 사용하는 경향은 연구자의 특성과 논문 유형에 따라서도 차이를 보였다. 이번 연구에 따르면 사전공개 논문을 자주 올리는 저자가 쓴 논문일수록 LLM 활용도가 높았다. 또한 경쟁이 치열한 연구 분야, 즉 유사한 논문이 많고 빠른 출판이 요구되는 영역일수록 AI를 많이 이용했다. 분량이 짧은 논문 역시 LLM 개입 비율이 더 높았다. 결국 시간적 여유가 부족한 연구자일수록 AI에 의존할 가능성이 크다는 게 연구팀의 분석이다.

연구에 참여하지 않은 독일 튀빙겐대학의 데이터 과학자인 드미트리 코박 박사는 이번 연구논문을 분석한 국제학술지 ‘네이처’와의 인터뷰에서 "이건 매우 견고한 통계 모델"이라며 "연구자들이 AI의 흔적으로 의심되는 단어를 일부러 제거하고 있다는 사실까지 고려하면 실제 AI 사용 비율은 이보다 더 높을 수도 있다"고 평가했다. 그에 의하면 ‘delve(뒤지다/파고들다)’라는 단어는 챗GPT 등장 이후 갑자기 사용량이 증가했다가 AI 흔적이라는 사실이 알려진 뒤 다시 줄어들었다.

이번 연구는 과학 논문에서 LLM 대표주자인 챗GPT의 활용 여부에 초점이 맞춰졌지만 학계는 모든 학문 영역, 모든 LLM으로 대상을 확장하면 AI의 활용 비율이 더욱 높아질 것으로 보고 있다. 심지어 AI는 더욱 똑똑해지고 있으며, 올 2월에는 오픈AI에 의해 논문 한 편을 10분 이내에 뚝딱 작성해내는 ‘딥리서치(deep research)‘라는 괴물도 등장했다.

문제는 LLM이 때때로 존재하지 않는 사실을 사실처럼 제시하는 ‘환각’ 현상을 일으킨다는 점이다. 이러한 환각이 동료 검토와 편집과정에서 걸러지지 않고 최종 게재된다면 학술지의 신뢰성이 치명상을 입을 수 있다. AI 의존도가 높아질수록 과학자의 창의성과 비판적 사고력이 저하될 수 있다는 경고도 좌시하기 어렵다.

연구팀은 "AI 활용이 막을 수 없는 시대적 흐름이라면 그것이 과학적 진실성과 연구 윤리에 어떤 영향을 미치는지에 대한 깊은 성찰과 제도적 대응이 필요한 시점"이라고 강조했다.